Добро пожаловать в мир SRE¶

Если спросить у десяти разных технарей из IT, кто такие SRE, то можно получить двенадцать разных ответов. Для одних это "дорогие продвинутые сисадмины", для других - "дежурные, которые пялятся в дашборды", для третьих - "мифические единороги из Google, которые делают что-то с Kubernetes".

А если то же самое спросить у "гуманитариев из IT" от менеджеров до продактов - то тут вообще можно очень сильно удивиться версиям от "те, кто виноват, когда всё падает" до "те, которые мешают нам быстро выпускать фичи" и "те, кем можно затыкать все дыры, потому что им очень много платят и не понятно, что они делают".

Такая путаница неслучайна - профессия SRE родилась на стыке операционной деятельности и разработки, и её суть не помещается в привычные узкие рамки IT-ролей.

Это не следующая ступень карьеры системного администратора и не просто модное переименование DevOps. Это принципиально иная инженерная дисциплина, и, чтобы понять её, нужно начать с самого начала - почему мир IT в целом перешёл от философии "администрирования" к культуре "инженерии".

Обеспечение надежности информационных систем — это инженерная дисциплина, призванная помочь организации стабильно достигать соответствующего уровня надежности своих систем, сервисов и продуктов.

Почему мир IT перешел от "администрирования" к "инженерии"?¶

"Вот были же раньше сисадмины, а сейчас они стали называться SRE, а так это то же самое, ничем не отличаются, только платят им в пять раз больше почему-то".

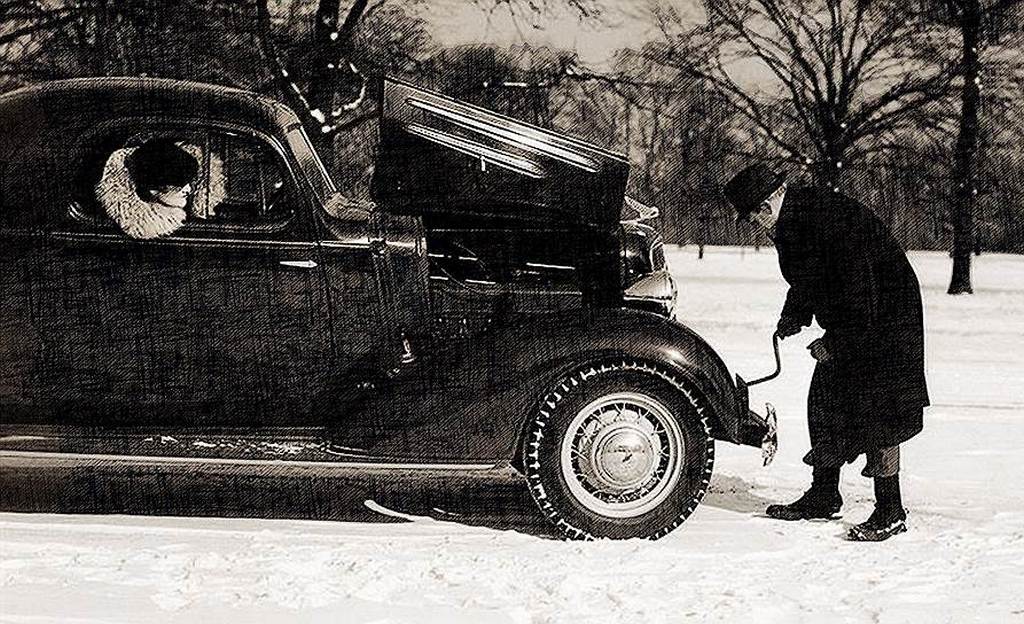

Представьте себе, что вам нужно каждое утро заводить автомобиль, проворачивая заводную рукоятку. Вы стоите на морозе, прилагаете физические усилия, а процесс отнимает драгоценные минуты.

Мир IT прошёл через похожую эволюцию. Так работали вычислительные системы не так давно: инженеры вручную собирали и настраивали серверы, "крутили ручки" и реагировали на сбои, когда они уже произошли. Это был мир системного администрирования (SysAdmin).

А теперь представьте современный автомобиль: он заводится с кнопки, сам предупреждает о низком давлении в шинах, а в критической ситуации система стабилизации вмешается быстрее, чем вы успеете сообразить.

В мире IT это аналогично переходу к инженерии надежности (Site Reliability Engineering, SRE). Это не просто смена вывески - это фундаментальная трансформация подхода к созданию и поддержке сложных, динамичных распределенных систем, от которых сегодня зависит вся мировая экономика, от онлайн-платежей до систем телемедицины.

Слово "Site" в аббревиатуре SRE - это самый коварный и неправильно понимаемый термин во всей дисциплине. Когда вы слышите "Site Reliability", первая мысль - "надёжность сайта". И это самая распространённая ошибка переводчиков. В оригинальном контексте Google (где родился термин в начале 2000-х) "Site" означало "дата-центр", "площадка", "место размещения инфраструктуры". Сегодня под "Site" в SRE понимают любую IT-систему, которая должна работать надёжно: вебсайт, облачный сервис, мобильное приложение, банковский кредитный конвеер, инфраструктурную платформу, автомобиль и т.д. и т.п. - всё, где работает ваша цифровая ценность.

И да, считаю очень важным подчеркнуть: инженерию надежности, как практику, придумал не Google - она логично выросла из теории надёжности, применённой к реалиям гипермасштабных IT-систем. И, надеюсь, что ни для кого из действующих SRE не будет открытием, что существует семейство стандартов ГОСТ 27.* "Надежность в технике".

Традиционная роль системного администратора была, по сути, реактивной. Его мир строился вокруг конкретных машин - физических серверов в стойке с уникальными именами и причудливой историей конфигураций ("почему этот сервис работает только на server-05 - спросите у Васяна, он его настраивал в 2012-м").

Ключевые черты эры SysAdmin:

-

Фокус на стабильности любой ценой: Изменения были опасны, релизы очень редкими и болезненными событиями, похожими на хирургическую операцию, и, после каждого релиза проходил процесс "лечения" - восстановления того, что сломали этим релизом, точно, как выздоровление после болезни. Главным принципом было "Не трогай и не сломается!".

-

Ручной труд (toil) как норма: настройка, деплой, масштабирование - всё через скрипты на bash и командную строку, часто ночью или в выходные. Администраторы были "пожарными", героически тушившими инциденты.

-

Разделение на "мы" и "они": четкая граница между разработкой (Dev), которая пишет новый код и хочет изменений, и эксплуатацией (Ops), которая отвечает за стабильность и сопротивляется изменениям. Этот конфликт порождал недоверие и медлительность. Одним нужно было пилить и катить до прода фичи любой ценой (а то премию не дадут), а другие стояли грудью за прод, не пуская туда то, что его ломало.

Такая модель работала, пока системы были относительно простыми, а требования к скорости обновления очень низкими.

Затем наступила эра, которая предъявила принципиально новые требования:

- Облака и виртуализация: инфраструктура перестала быть "сервером в стойке", превратившись в программно-определяемый ресурс, который можно автоматически создавать и уничтожать за секунды.

- Микросервисная архитектура: монолит распался на сотни и тысячи независимых сервисов. Управлять вручную их взаимодействием, версиями и масштабированием стало физически невозможно.

- Конкуренция и скорость выхода на рынок: бизнес потребовал выпускать обновления не раз в полгода, а ежедневно или ежечасно. Модель "редких болезненных релизов" стала губительной для бизнеса.

- Масштаб: количество пользователей, данных и транзакций выросло на порядки. Проблемы, которые раньше решались добавлением одного сервера, теперь требовали системного, алгоритмического подхода.

Инфраструктура как Код (Infrastructure as Code, IaC) стала первым критическим мостиком в эту новую реальность. Такие инструменты, как Terraform и Ansible, показали, что конфигурацию серверов и сетей можно описывать, версионировать и тестировать как программный код. Это был первый шаг от администрирования к инженерии.

В конце 2000-х стала набирать силу философия DevOps - культурное и профессиональное движение, направленное на устранение барьера между разработкой и эксплуатацией. Её лозунг: "You build it, you run it" ("Ты построил — ты и управляй").

DevOps предложил принципы автоматизации, непрерывной интеграции и доставки (CI/CD), измерения всего и общего чувства ответственности. Это был критически важный шаг, но часто он оставался философией, набором практик без четкой инженерной дисциплины для управления надежностью в гипермасштабе. Нередко DevOps-трансформация приводила к размытой ответственности: если за что-то "все отвечают", то на практике зачастую оказывалось, что за это не отвечает никто.

Вопрос оставался открытым: как именно, на практике, команда должна "управлять" тем, что она построила, особенно когда это глобальный сервис с миллиардами запросов в сутки? Как измерить "управление"? Как балансировать между скоростью выпуска фич и железобетонной стабильностью на основе данных, а не интуиции?

Именно на этот вопрос в середине 2000-х дала ответ Google, сформулировав дисциплину Site Reliability Engineering. Ключевой момент: Google не придумала её из воздуха, а облекла принципы классической теории надежности в конкретные, применимые в IT практики. Бен Трейнор, один из её создателей, дал простое, но гениальное определение: "SRE — это то, что происходит, когда вы поручаете инженеру-программисту решать задачи системного администратора".

В этой фразе — вся суть перехода от администрирования к инженерии.

-

Инженер-программист мыслит продуктами, алгоритмами, автоматизацией и масштабированием. Он не "крутит ручки", а пишет код, который исключает саму необходимость их крутить.

-

Задачи системного администратора — это обеспечение доступности, производительности, емкости, мониторинга, реагирования на инциденты.

SRE — это их синтез. Это подход, который применяет строгий, количественный, инженерный метод к проблемам эксплуатации и надежности.

Основа SRE: бюджет ошибок (Error Budget)¶

Error Budget превращает конфликт между разработкой и сопровождением в их партнерство.

Представьте, что у вас есть сервис с целью доступности 99,9% (SLO). Это означает, что за месяц он может простаивать без последствий не более 43 минут. Эти 43 минуты — и есть ваш бюджет на ошибки.

-

Для разработки (Dev) этот бюджет не ограничение, а ресурс для инноваций. Пока бюджет не израсходован, можно безопасно выпускать новые функции, даже с некоторым риском. Это переворачивает парадигму с "изменения — зло" на "изменения — управляемый риск".

-

Для SRE бюджет это объективный измеритель риска. Если бюджет исчерпан, все усилия переключаются на повышение надежности, а выпуск новых функций приостанавливается.

Бюджет ошибок превращает конфликт "скорость vs. стабильность" в конструктивное партнерство на основе общих, измеримых данных. Это и есть сердце, основа основ SRE.

Выбор самого SLO (99,9%, 99,99% или 99,999%) — это не абстрактная гонка за девятками (надеюсь), а экономическое решение, где каждая "девятка" надёжности имеет свою цену для бизнеса и пользователей.

Чем SRE не является? Разрушаем мифы¶

Чтобы избежать мифов, важно прояснить:

- SRE - это не "продвинутые Ops". Это не следующая ступенька карьеры системного администратора (хотя скиллсет пересекается). Это принципиально иная роль с фокусом на разработку ПО для управления инфраструктурой. Идеальный SRE тратит 50% и более времени на проектную работу.

- SRE - это не синоним DevOps. SRE это наиболее конкретная и успешная реализация философии DevOps, ее "практическое воплощение" с четкими инженерными практиками, ролями и метриками.

- SRE - это не только для гигантов вроде Google или Netflix. Принципы SRE универсальны, разница лишь в масштабе и инструментах. Стартап может применять те же подходы (SLO, автоматизацию, blameless-культуру) к своему единственному продуктивному кластеру в облаке.

- SRE - это не "24/7 дежурные инженеры". Хотя практика on-call существует, её цель не в героическом тушении одних и тех же пожаров, а в сборе данных для их последующего полного устранения через автоматизацию. Идеал - система, которая "самоисцеляется", а люди вмешиваются исключительно для анализа уникальных, сложных сбоев.

Итак, почему?¶

Потому что сложность современных распределенных систем превысила порог, управляемый вручную. Администрирование, основанное на реакции и ручном труде, стало узким местом для бизнеса, которому нужны скорость, масштаб и предсказуемая надежность.

Мир перешел от "администрирования" к "инженерии", потому что:

- Масштаб требует автоматизации и кодоцентричного подхода.

- Скорость изменений требует количественной оценки риска (Error Budget), а не его запрета.

- Сложность требует культуры безупречного анализа (blameless postmortem), а не поиска виноватых.

- Бизнес-требования требуют чёткого языка для обсуждения надежности (SLO/SLA) между инженерами, менеджерами и клиентами.

Эта книга - попытка развеять мифы и показать, как SRE превращает поддержку сложных систем из ремесла в строгую инженерную дисциплину. Мы начнем с фундамента — теории надежности и языка SRE, затем разберем его основные столпы (мониторинг, управление инцидентами) и, наконец, погрузимся в инженерные практики, которые превращают поддержку системы из искусства в науку.

Добро пожаловать в мир, где надежность не обеспечивается героическими усилиями отдельных людей, которых эта система круглосуточно сжигает пачками, а проектируется и встраивается в систему с самого начала работы над продуктом.

Добро пожаловать в мир SRE.

При написании книги использовались Claude Code и Kimi K2.5